已有研究团队能在1.1K温度下运作的量子计算平台

2020-04-26

来源:Ai芯天下

从精密的药物研发到搜索算法,在许多重要问题上,量子计算机都有望胜过传统计算机。然而,设计一种可以在实际环境中制造和运行的量子计算机是颇具挑战性的系统工程。

各大巨头将量子计算研究推向高潮

目前量子计算和量子通信等最前沿的量子信息技术,成为当下科技界和工业界追捧的大热点,在全球的大型科技公司中,包括谷歌、IBM、英特尔、微软、阿里巴巴在内的企业已投资数亿美元开发量子计算,更是将量子计算机的研究和竞争态势推向高潮。

谷歌在量子人工智能实验室运营着一台D-Wave量子计算机。该实验室由美国国家航空航天局和加州山景城NASA艾姆斯研究中心的大学空间研究协会共同创建。在2018年,谷歌宣布它已经建立了一个新的量子处理器,代号为Bristlecone。这款72比特的设备在谷歌此前最好的9量子比特机器取得了重大进步。在2019年初,谷歌在旧金山举行的IEEE国际固态电路会议上展示了为量子计算定制的电路。

IBM推出了一款名为“IBM Q System One”的20比特量子计算系统,用户可以通过云端访问该系统,并宣布为埃克森美孚和欧洲核子研究中心提供量子服务。IBM全球副总裁Norishige Morimoto最近表示IBM将在五年内将量子计算机商业化。

英特尔:在2019年3月,宣布了一种量子计算机测试工具,该工具允许研究人员验证量子芯片可靠性晶圆并检查量子比特在构建成全量子处理器之前是否正常工作。对于量子计算研究人员而言,这可能是一项重要的节省成本和时间的技术,也是量子处理器大批量生产的一个步骤。

微软在2017年底,微软宣布推出量子开发套件一种名为Q#的编程框架和语言,供寻求为量子计算机编写应用程序的开发人员使用。2019年2月,微软推出了微软量子网络一个致力于量子应用和硬件的机构和个人网络。微软表示其量子开发套件已被下载100,000次,并且它将开源其Q#语言,编译器和量子模拟器。

阿里巴巴旗下阿里云和中国科学院在上海建立了一个名为阿里巴巴量子计算实验室的研究机构。该实验室研究各个领域的量子计算应用,包括人工智能和电子商务和数据中心的安全性。2018年2月,阿里云推出了具有11个量子比特的量子计算云服务。

量子计算得到进一步发展

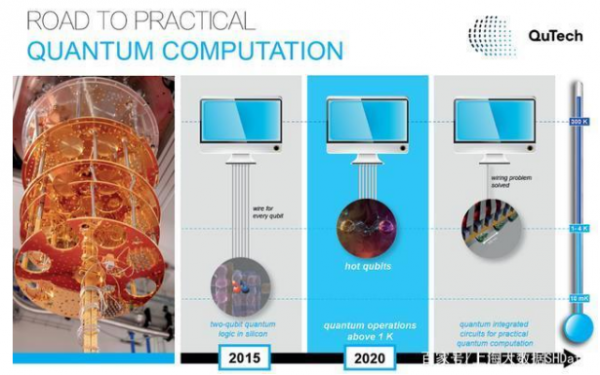

2020年4月15日,英特尔与代尔夫特理工大学和荷兰应用科学研究会合作创立的QuTech公司共同在《自然》杂志上发表了一篇论文,证明了在高于1开氏度下,能够成功控制“高温”量子位。一直以来,温度是困扰量子计算平台得到大规模应用的难题之一。研究团队都将研究重点放在热量子比特技术,添加到系统中的每个量子比特对都会增加产生的总热量,并且增加的热量会导致错误,所以量子计算平台的设计接近绝对零度。

而在新的研究成果表面,在温度高于 1K(零下 272.15℃)的硅基量子计算平台上,系统可以正常运作。这一突破突显出对未来量子系统和硅自旋量子位进行低温控制的潜力。一般来说,除非将量子位冷却到接近绝对零度(-273摄氏度,或0开氏度),否则量子位中存储的量子信息通常很快就会丢失。

随着这项研究的开展,硅能把超过 1K 温度下正常运作的材料很好地与周围物质隔离开,因此研究都将电子在硅中的自旋作为量子比特。在这种极低的温度下,制冷设备强大到可以允许引入局域电子来校正量子比特。

英特尔与研究团队的研发硅自旋量子位

英特尔和QuTech在研究中也证明了能够控制双量子位系统电子自旋的能力,并测量出单量子位保真度高达99.3%,且可对系统进行精确调整。并且在45毫开氏度到1.25开氏度的温度范围内,自旋量子位的性能受影响最小,从而向量子计算的可扩展性迈出了一步。

自旋量子位制造流程,基于300毫米工艺技术,使用的是同位素纯晶圆。硅自旋量子位是英特尔实现量子计算一个独一无二的路径,这个路径非常适合使用英特尔现在的一整套硅半导体工艺,发挥出英特尔的优势。英特尔已经可以在12寸的晶圆上制造出两个硅自旋量子位,然后控制它们进行纠缠。

硅自旋量子位的优势是可以利用具体粒子做量子位,实现起来体积更小,更适合构造大型量子计算系统。 利用硅自旋量子推进量子计算,让英特尔能够利用在先进封装和互连技术方面的专业性,为实现量子实用性开辟一条可扩展的道路。

量子计算高于传统计算机优势

①量子模拟(Quantum simulation),量子计算机对复杂分子进行建模模拟;

②优化(Optimization),即以前所未有的速度解决多变量问题;

③量子人工智能(AI),具有更好的算法,可以改变制药和汽车等行业的机器学习;

④素因数分解(The prime factorization),这可能会彻底改变以往的加密技术。

量子计算发展难点

物理量子比特的不稳定性

量子比特的不稳定性与经典计算机的比特不同,量子比特可以表示0和1的组合叠加状态(叠加态),但是在物理环境下,其叠加状态并不稳定。因此,要确保量子计算机芯片上的某个位不干扰该芯片上的任何其他位,那就需要做大量的辅助工作。

数学问题障碍大

从初创公司到研究机构,再到Google、IBM和Microsoft之类的软、硬件公司,都在努力克服这一数学问题障碍。量子计算作为一种概念早在1980年代就已经存在,但直到2019年9月,Google才宣布其量子计算机仅用2分30秒就解决了传统超级计算机需要耗时10000年才能解决的问题时,量子计算机才首次用事实证明。

未来量子计算应用前景

通过模拟仿真缩短化学药品开发的时间

寻求开发新药物和新物质的科学家经常需要了解分子的精确结构,以确定其特性,并了解其如何与其他分子相互作用。但即使相对较小的分子也很难用经典计算机准确地建模,因为每个原子都在以复杂的方式与其他原子相互作用。当前的计算机几乎不可能精确模拟哪怕较少原子数目的基本分子。

而量子计算机其物理本质上就非常适合解决这个问题,因为分子内原子的相互作用本身就是一个量子系统。而专家认为,实际上量子计算机甚至可以对人体中最复杂的分子进行建模。因此在这个方向上的每一点进展都将推动新药和其他产品的更快发展,并有可能带来变革性的新疗法。

颠覆性的速度,解决优化问题

在每个行业中,许多复杂的业务问题都涉及诸多变量。如果用经典计算解决如上这些问题,这将非常艰巨。为了独立驱动性能提升或损失的输入,必须严格限制在任一计算中其可变动的变量数量。因此在任何计算中可变动的变量数量必须受到严格限制,但经典计算代价高且耗时长。

由于量子计算机可以同时处理多个变量,使得它们可以在很短的时间内显著地缩小可能的答案范围。这样一来,经典计算就可以在一个很小的范围内得到确切的结果。尽管如此,与量子计算相比,它的工作效率仍然很慢。由于量子技术消除了很多可能性,因此这种混合方法将大大缩短寻找最佳解决方案所需的时间。

量子人工智能加速自动驾驶的研发

量子计算机有可能加速自动驾驶汽车时代的快速到来。在福特、通用汽车、大众汽车和其他汽车制造商以及新移动领域的众多初创企业中,工程师们通过复杂的神经网络,长时间地来处理视频、图像和激光雷达数据。使用人工智能教会汽车做出关键的驾驶策略,这种方式训练人工智能算法需要一系列密集型的计算,随着数据的增加,以及变量之间更复杂的关系的增加,使得计算变得越来越困难。这样的训练需求可能会使世界上最快的计算机连续工作数天甚至数月。

而由于量子计算机可以同时执行多个变量的复杂计算,因此它们可以指数级地加速这类人工智能系统的训练。

结尾:

量子计算的发展会带动一场大的科技革命,就目前而言全球的科技公司的量子计算成果来说,量子计算的发展是有目可睹的,相信在不久的未来,困难点都会随着科技的不断发展逐渐完善。