从L2+到L4:多技术路径的ADAS发展,究竟需要什么样的芯片?

2022-01-19

来源:21ic中国电子网

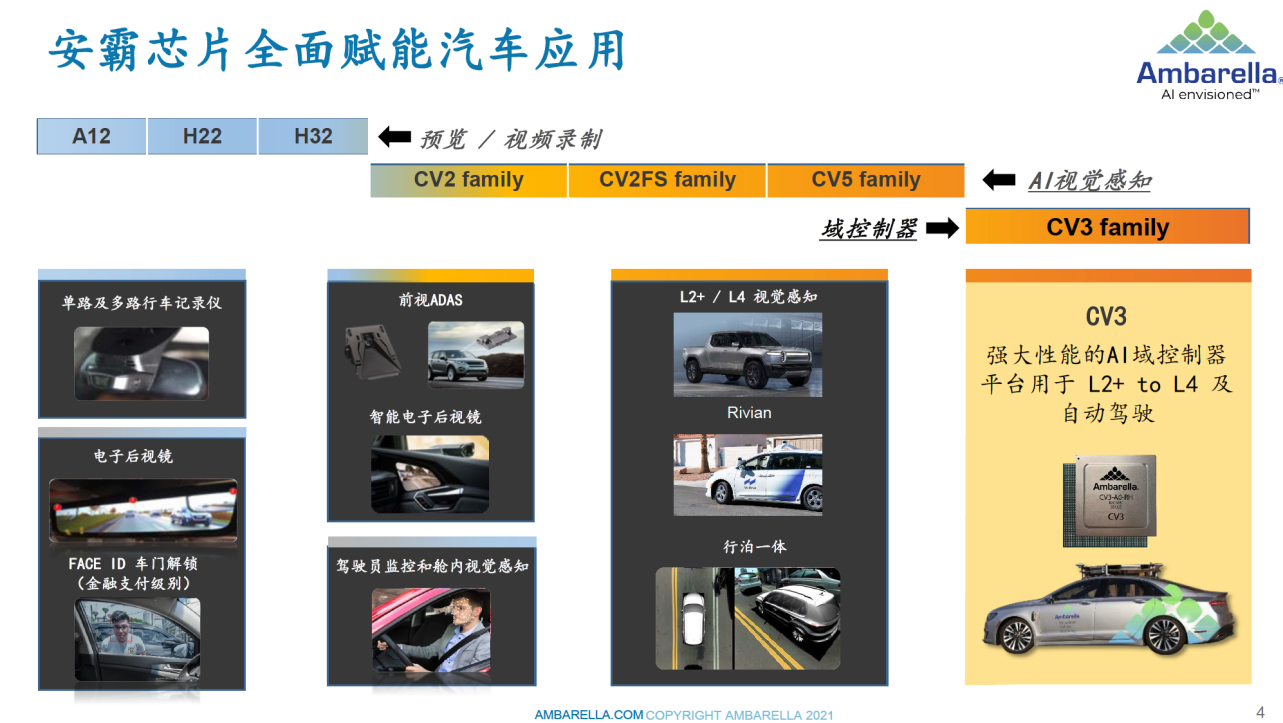

在刚结束的CES上,车载计算芯片成为了展会的重头戏,汽车自动驾驶成为了行业巨头争夺的热门市场。安霸也发布了其搭载最新一代CVflow架构的汽车域控制器芯片——CV3系列。本文从CV3出发,看到当前汽车域控制器的市场需求和走向;以及如何在市场发展前期多样化的局面下,把握车载计算芯片的专用性和通用性的平衡。

从L2+到L4:多路径、百花齐放

当前的智能汽车的ADAS处在蓬勃发展的阶段,正在实现从L2+到L4的迈进。SAE将L0~L2级定义为驾驶辅助类,L3~L5级定义为自动驾驶类。在当前的自动驾驶发展阶段,目前既有特斯拉蔚来这种新势力车厂、也有谷歌百度这种大型IT公司、也有亚马逊阿里这样的云服务商、也有福特大众传统车企、也有小米苹果这样的消费类厂商。从不同的定位、不同的落地场景和不同的技术储备出发,也就有着不同的考量,所以ADAS当前的技术路线也呈现多样性。到车载计算芯片的定义上,PPA虽然是一致的追求,但具体的架构、片上接口资源和特性等也就各不相同。不同的芯片厂商例如高通、TI、英伟达等,结合自己对于ADAS应用的理解,也就开发出了不一样的产品。

图:SAE给出的六个自动驾驶级别

“关于自动驾驶的产业生态,尤其是在中国,会有多种发展路径。很多家公司因为它落地场景不一样,对成本要求不一样,会采取非常不一样的路径。”安霸中国区总经理冯羽涛分享到,“有非常多的公司采取了不同的发展路径,有一些是直接进入全自动驾驶的方向,它会跳过前面部分。大家常用的自动驾驶L1、L2的分级,后面直接研发到全自动驾驶,但是也有很多公司会采取逐渐发展的方式,多种路径在国内都会存在,而且在快速发展期会非常多样化。”所以,在这个蓬勃发展的初期过程,各个公司的智能驾驶方案的会从其落地场景出发,平衡其传感器配置以及系统整体成本。

图源:Yole

在市场和行业的当前发展阶段,没有强合作绑定关系的汽车计算芯片的厂商,在进行自己的产品定义的时候,需要在ADAS专用的前提下,架构上有一定的张力,也就是通用性,保证能够适应各种不同的技术路线,不同的ADAS处理算法。这也就是安霸最新的CV3系列芯片的定义出发点,冯羽涛表示,“ 安霸作为芯片供应商,我是希望能够服务于所有的这些自动驾驶厂商。所以我们对自动驾驶的判断就像我开篇说的,我觉得会多种发展路径,多传感器感知融合,这也是CV3的设计思路。”

汽车计算芯片——算法为先优化架构

在ADAS兴起之前,汽车上对于图像和视频的采集最终都是需要人来观看处理,ISP相关技术是关键。所以安霸最初涉足汽车电子领域,专注行车记录仪和电子后视镜等图像和视频处理芯片,当时的“算法优先”考虑于处理好颜色、对比度和清晰度等细节。在这个阶段,安霸就开始奉行“算法优先”的理念,A12、H22和H32芯片架构非常适合这些图像处理的算法需求,这也是其在这一领域首先取得成功的关键原因。

而后随着驾驶辅助应用的兴起,AI视觉感知技术成为了关键。AI视觉感知对于算法的依赖程度更高,为了实现更高的计算效率,需要架构与算法实现更紧密的耦合。安霸于2015年收购了有着25年自动驾驶经验的VisLab公司,深入了解自动驾驶汽车的算法对于芯片的需求,做出适应更多算法和自动驾驶的AI加速硬件架构CVflow,这一架构下的产品有CV2x系列、CV2FS系列和CV5系列。而后又在2021年收购了傲酷,这是一家全球领先的4D成像雷达算法公司,可以用较少的硬件资源达到非常清晰的雷达成像。通过对傲酷的算法吸收,安霸在雷达感知与视觉融合算法有了更深入的理解。通过这些一系列的在视觉、雷达等传感器数据处理算法上的积累和沉淀,安霸在此次CES上推出了搭载新一代CVflow架构的CV3系列,实现ADAS专用的同时又保证了算法的通用性,布局汽车AI域控制器领域。

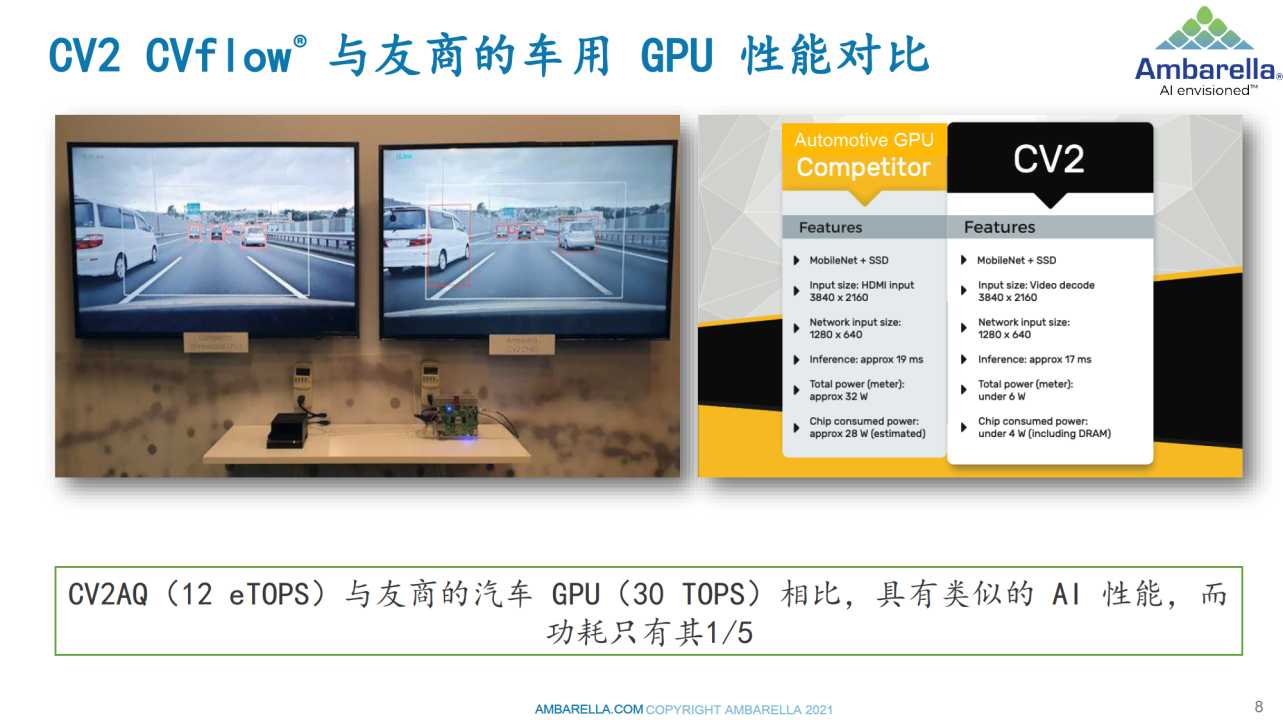

因为是专门为算法优化的架构,所以不能单纯的看TOPS这一参数,安霸的芯片在算力表达上有所不同,从CV2x系列产品开始就用“eTOPS”来表示。e代表着Equivalent,也就是等效TOPS的意思。将同一个神经网络运算,跑在CVflow架构的芯片上和跑在GPU上来进行对比。如果能把相同的神经网络算法跑到等效的这么快,就叫做Equivalent TOPS,简称eTOPS。这是源自专用的CVflow更接近系统表现的算力的一种表达。

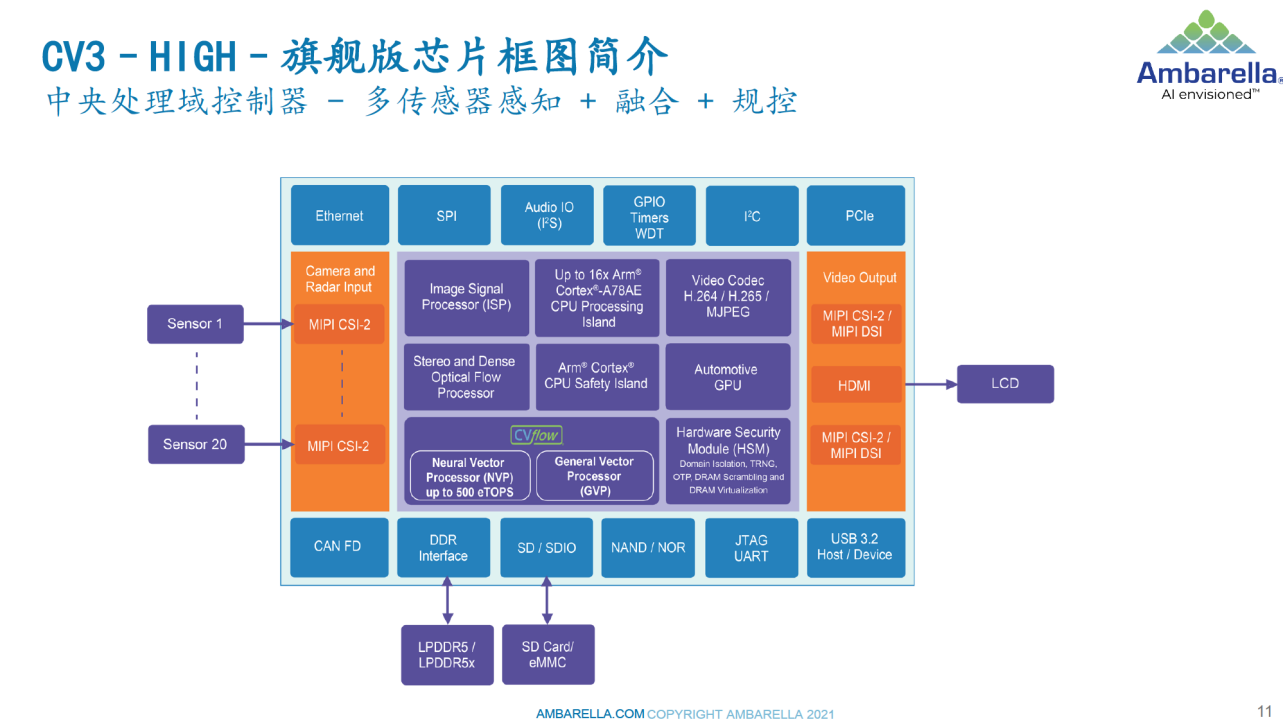

单芯片域控制器CV3:高算力、雷达和视觉原始数据融合

新一代的CV3为单芯片域控制器,首发的型号为最高性能的旗舰版,后续会在旗舰版的基础上陆续推出新的低成本型号。CV3采用了和CV5相同的5nm 低功耗制程,内置了16个Arm Cortex-A78AE内核,搭载了新一代的CVflow架构,AI算力高达500 eTOPS,比CV2 系列提高了42 倍,每瓦性能比提高了4倍。单芯片集成多传感器进行集中化AI 感知处理(包括高像素视觉处理、毫米波雷达、激光雷达和超声波雷达)、多传感器深度融合以及自动驾驶车的路径规划。

新一代的CVflow中包含NVP和GVP两个向量处理器,从命名就可以看出,一个是专门做神经网络的向量处理,一个是通用的向量处理。NVP针对4bit、8bit、16bit这种定点运算有着专门的优化。GVP对16bit、32bit浮点运算的支持比较好。据冯羽涛分享,新一代CVflow的设计思路来自于和当前行业客户的深入沟通。目前很多客户的算法是混合的,既有传统算法,也有神经网络的算法。定点运算和浮点运算需求混合存在,所以针对不同的需求设计了不同的向量处理资源,来实现更高效率的处理。例如最近非常流行的Transformer网络,需要的运算就是直接的多维向量矩阵乘法,这种计算需求在NVP上处理的效率就会高很多,安霸也在NVP中对这一网络进行了专门的硬件支持。此外,CVflow的灵活性不仅仅体现在针对不同计算需求的处理上,在整个CV3的产品map里, 也可以通过调整CVflow中NVP和GVP的数量,来调整芯片的计算资源,结合其他的芯片资源的调整,实现产品型号由高到低的布局。

CV3的另一个特点在于可以将雷达数据和视频数据在原始的数据集上进行处理,实现传感器数据的深度融合计算。这也是行业内传感器融合的一个发展趋势,在前端完成原始数据的分析、学习和融合处理。

据安霸中国区市场营销副总裁郄建军分享,在视频和雷达的融合方面,一般的做法都是“后融合”或目标级融合。而在CV3芯片里就可以做“前融合”,也就是视频的像素和雷达的点云做原始数据级的融合。这种融合的挑战在于处理的数据量很大,处理的实时性要求更高。需要保证点云和像素对位准确,时空同步做的非常好。CV3上的这种“前融合”会使感知的整体性能包括置信度大幅度提升,误检率、漏检率大幅度下降。CV3中结合了傲酷的4D成像雷达算法,在和视频做前融合以后,整体性能可以做到类似低线束激光雷达的效果,在某种程度上可以取代低线束激光雷达。

从CV2的4核A53到CV3的16核A78AE(4个集群),是跟进Arm架构的升级,响应某些用户对于传统算法和算力提升的需求。采用四个集群的设计,也是从系统开发的角度出发,可以分别在不同的集群上部署不同的功能,实现更为独立的软件开发。结合CV3支持20个摄像头的接入,这些特性对于有“硬件预埋”需求的厂商而言,也是非常必要的,保证一定的硬件资源冗余。

总结

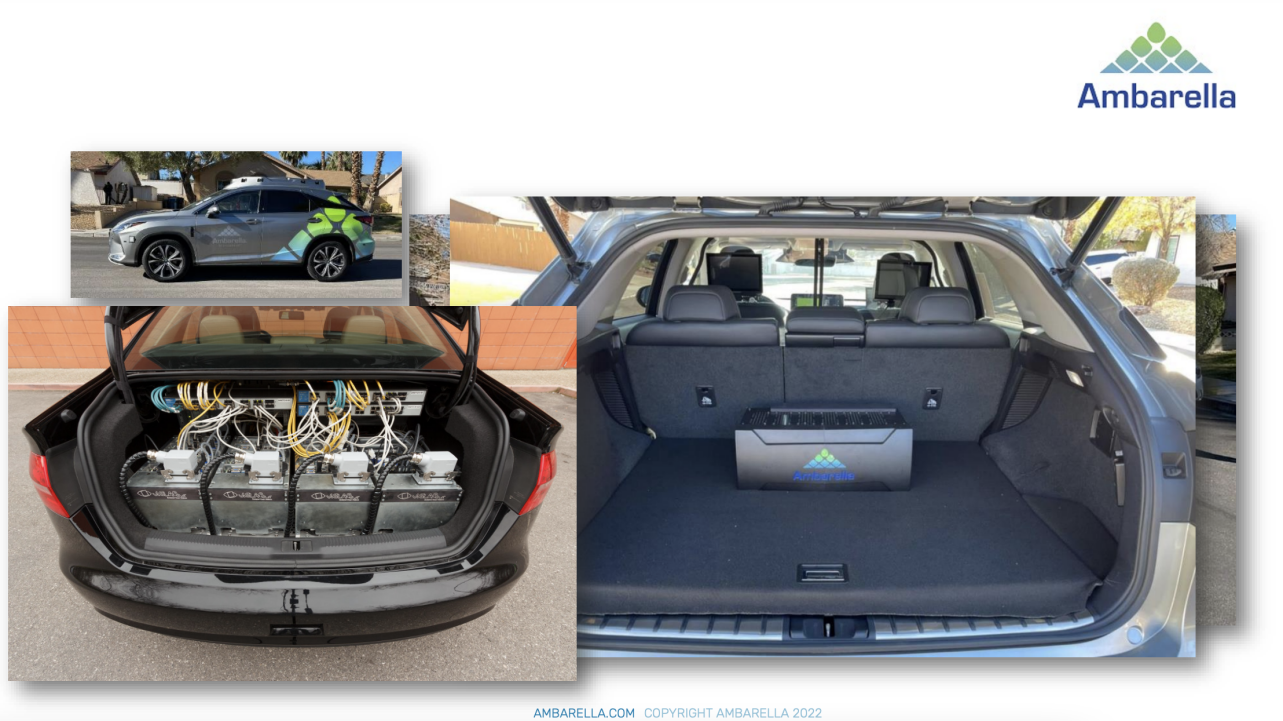

当安霸在2015年收购VisLab的时候,VisLab自己做的自动驾驶demo车里,后备箱里满满的PC处理器。当时安霸就想到,下一代能够用一颗芯片取代这满满一后备箱的PC处理器,达到同样的计算能力。现在CV3的出现,单芯片高算力、前置雷达和视觉原始数据融合、灵活的CVflow架构、4集群16核的通用计算能力…已经将这一愿景达成。

在当前百舸争流的ADAS赛道上,既要做ADAS算法专用的芯片,架构上优化算法 ,坚持算法优先策略;又要考虑各家不同算法的需求、不同传感器的需求、实现一定的通用性。CV3的出现,可以帮助不同类型的玩家,让ADAS从L2+到L4的发展更加精彩。