谷歌发布新型AI内存压缩技术 内存需求得解

2026-03-26

来源:快科技

3月26日消息,谷歌研究院推出全新AI内存压缩技术TurboQuant,精准破解AI推理的内存瓶颈。

该技术可在不损失精度的前提下,将大语言模型缓存内存占用至少缩减6倍,推理速度最高提升8倍。

AI模型运行时有一种“工作内存”,即KV缓存(Key-Value Cache)。每当模型处理信息、生成回答时,KV缓存便会迅速膨胀,且上下文窗口越长,缓存占用的内存越大。

这已成为制约AI系统效率与成本的核心瓶颈,并非模型不够智能,而是运行时的内存难以支撑。

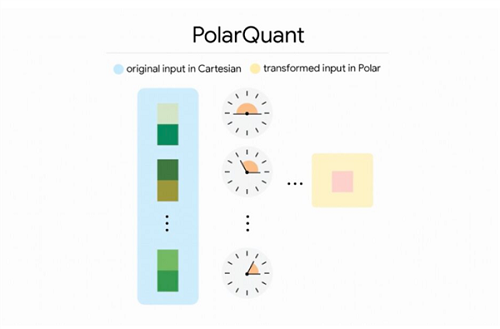

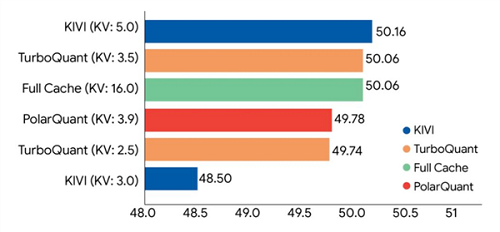

TurboQuant采用向量量化的方法对缓存进行压缩,使AI在占用更少内存的同时记住更多信息,且保持准确性。实现这一效果的关键在于两项技术:名为PolarQuant的量化方法,以及名为QJL的训练与优化手段。研究团队计划在下个月的ICLR 2026会议上正式发布相关成果。

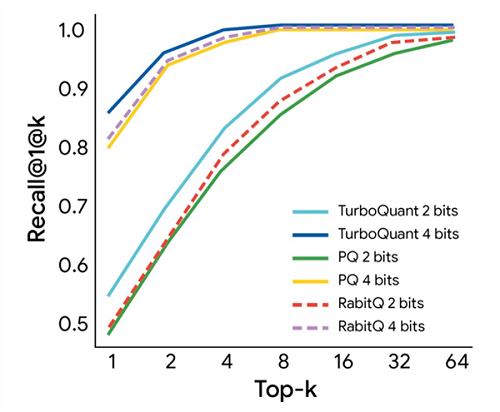

研究团队在Gemma和Mistral等开源大模型上进行了严格的基准测试。实验数据显示,TurboQuant无需任何预训练或微调,即可将键值缓存高效压缩至3比特,在“大海捞针”等长上下文测试中实现零精度损失,内存占用降至原来的六分之一。

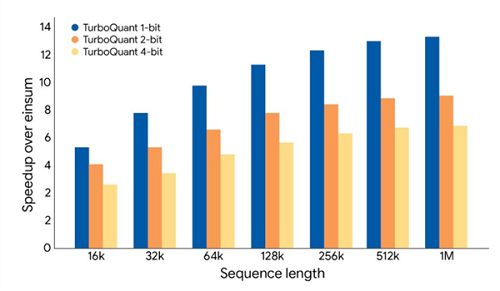

此外,在H100 GPU加速器上,4比特TurboQuant的运行速度较未量化的32比特基准提升了高达8倍。

内存需求会降低,还是会带来更大需求?

针对TurboQuant技术会引发了整个市场对于内存需求断崖式下跌的担忧,产业专家与研究机构也给出了截然不同的看法:

富国银行(Wells Fargo)分析师Andrew Rocha指出:“当context window(上下文窗口)越来越大,KV Cache的爆炸性成长原本是推升內存需求的保证。但TurboQuant正在直接攻击这条成本曲线,一旦被广泛采用,数据中心对內存容量的规格要求将被打上大问号。”

不过,知名投行摩根士丹利(Morgan Stanley)和研究机构Lynx Equity Strategies则给出了截然不同的观点,

摩根士丹利认为市场可能忽视了“效率提升带动总量增长”的经济规律。当AI计算所需的内存成本降低到原本的1/6,这将会使得原本因内存太贵而无法上线的AI应用(如长文本翻译、复杂代码生成)需求大规模爆发,反而会填补、甚至超越被压缩掉的内存缺口。

这就是杰文斯悖论(Jevon's paradox),即当技术进步提高了使用资源的效率(减少任何一种使用所需的数量),但成本降低导致需求增加,令资源消耗的速度不减反增。

摩根士丹利分析师约瑟夫·摩尔(Joseph Moore)及其团队在周四发布的投资者报告中指出: “有报道称谷歌的TurboQuant会导致内存使用量减少了到原来的1/6,但这忽略了他们仅仅指的是KV Cache,而不是整体内存使用量。

“值得注意的是,谷歌的 Gemini 3 和 2.5 Pro 模型都拥有 100 万个Token的上下文窗口,但谷歌曾透露,他们使用 Gemini 1.5 Pro 测试过高达 1000 万个Token的上下文窗口,并取得了非常好的结果,但由于推理成本较高,他们最终没有发布该模型,”摩尔说道。“因此,我们预计,随着此类创新以及其他技术的出现,成本将会降低,这项技术将被用于服务于更智能、计算密集型的产品。”

摩根士丹利进一步指出,TurboQuant主要优化的是“推理阶段”的缓存,并非“训练阶段”的模型权重。因此,对于支撑AI核心训练的HBM(高频宽內存)采购逻辑影响相对有限。

相比之下,TurboQuant对手机、笔记本电脑等终端设备的人工智能部署更具意义。由于移动设备的內存有限,这类高效压缩技术能让更强大的AI模型在手机端运行,这反而会刺激各类终端装置进行內存规格的全面换代。

Lynx Equity Strategies 的观点认为,虽然人工智能提供商需要创新来解决推理中随着Token上下文长度增加而出现的瓶颈问题,但由于供应限制,这在未来三到五年内并不会减少对内存和闪存的需求。